Die Lizenz-Falle der Hyperscaler-KI

Die Logik der großen Anbieter ist einfach: ein vortrainiertes Sprachmodell mit Chat-Oberfläche, integriert in die jeweilige Office-Welt, abgerechnet pro Nutzer und Monat. Für den Einzelnutzer wirken die Tarife überschaubar. In einem Unternehmen mit 80 Mitarbeitern aber summiert sich das schnell:

- Microsoft 365 Copilot — laut Anbieter-Listenpreisen rund 30 € pro Nutzer und Monat, on top auf die bestehende M365-Lizenz

- ChatGPT Team — rund 25 $ pro Nutzer und Monat bei jährlicher Abrechnung, etwas höher im flexiblen Tarif

- Google Gemini Workspace — Team-Tarife im Bereich von rund 18 bis 30 € pro Nutzer und Monat

- Claude Team — rund 25 $ pro Nutzer und Monat, mit Begrenzung des Token-Budgets

Stand: öffentlich publizierte Listenpreise der jeweiligen Anbieter, Mai 2026. Tatsächliche Konditionen können je nach Vertrag und Region abweichen.

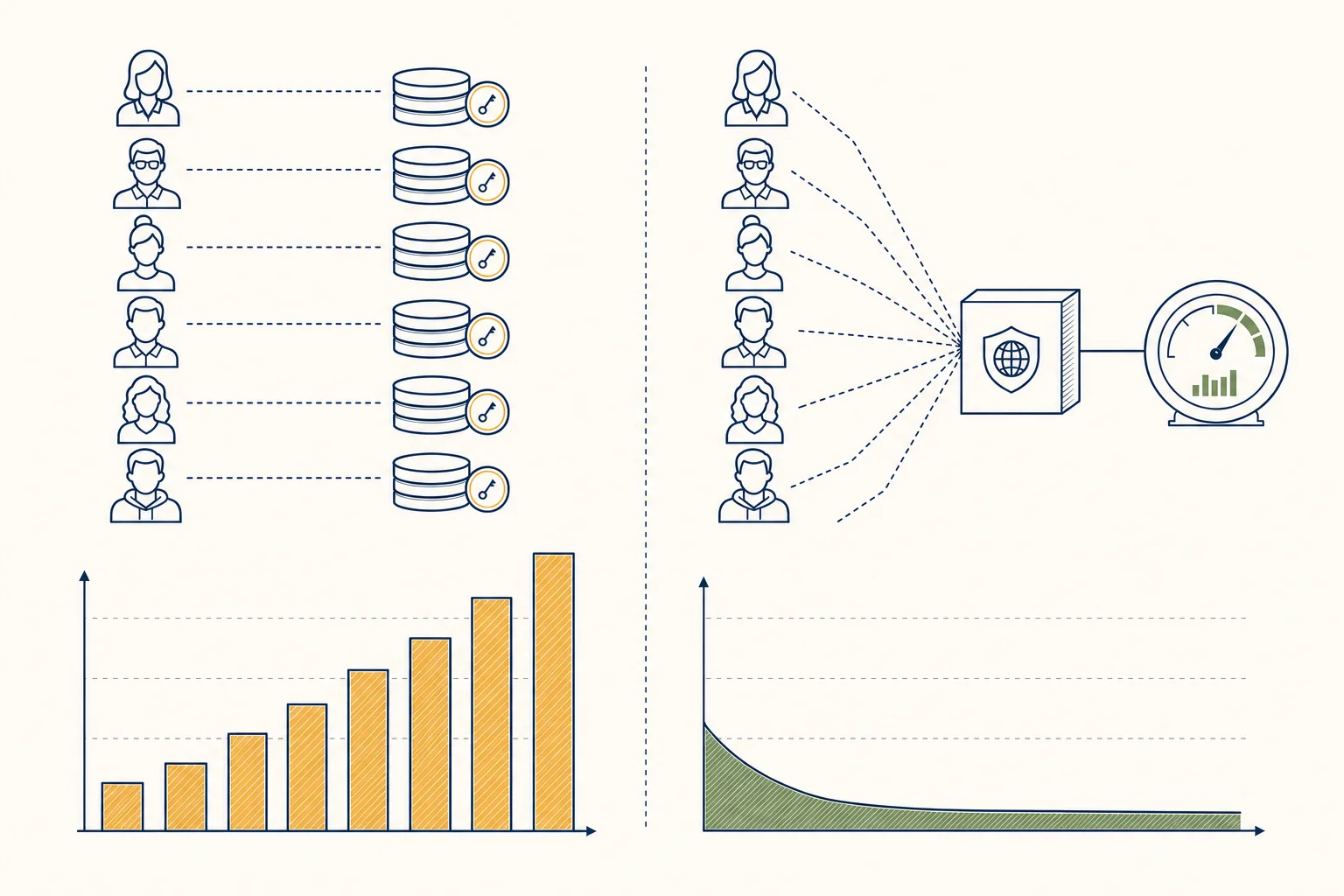

Bei 80 Mitarbeitern und Copilot landen wir bei rund 28.800 € pro Jahr — zusätzlich zu den bestehenden Lizenzen. Bei 200 Mitarbeitern verdoppelt sich das. Hinzu kommt: Diese Lizenzen sind pro Kopf gerechnet, auch wenn ein erheblicher Anteil der Mitarbeiter den KI-Assistenten nur sporadisch nutzt. Der durchschnittliche Mittelständler bezahlt für eine flächendeckende Nutzung, die er gar nicht hat.

Was ein eigener KI-Proxy wirtschaftlich anders macht

Ein KI-Proxy dreht das Lizenzmodell um: Statt jedem Mitarbeiter einen eigenen Account beim LLM-Anbieter zu geben, läuft die Kommunikation über eine zentrale Komponente. Diese Komponente hat eine einzige API-Beziehung zum Anbieter — die Kosten richten sich nach dem tatsächlichen Verbrauch (bezahlte Tokens), nicht nach der Zahl der Nutzer.

Eine grobe Beispielrechnung für einen Mittelständler mit 80 Mitarbeitern, von denen 20 den Assistenten täglich, 40 wöchentlich und 20 selten nutzen:

Kostenvergleich (Beispielrechnung 2026)

Variante A — Copilot pro Nutzer: 80 × 30 € × 12 = 28.800 € pro Jahr

Variante B — KI-Proxy + Token-Verbrauch: rund 4.000–8.000 € pro Jahr API-Verbrauch (geschätzt) plus 3.000–6.000 € Plattform/Betrieb = 7.000–14.000 € pro Jahr

Die konkrete Differenz hängt vom Nutzungsprofil, dem gewählten Modell und der Verhandlungsbasis beim Anbieter ab. Schon im konservativen Szenario ergibt sich gegenüber einem Per-Seat-Modell eine deutliche Kostenreduktion bei vergleichbarer Funktionalität.

Der wirtschaftliche Vorteil ist das eine. Wichtiger noch ist die Steuerbarkeit: Eine zentrale Komponente, die zwischen Nutzer und Modell sitzt, lässt sich kontrollieren. Lizenzen werden nicht mehr pro Person bewilligt, sondern als Plattformleistung bereitgestellt — und Sie behalten die Hoheit darüber, was wirklich passiert.

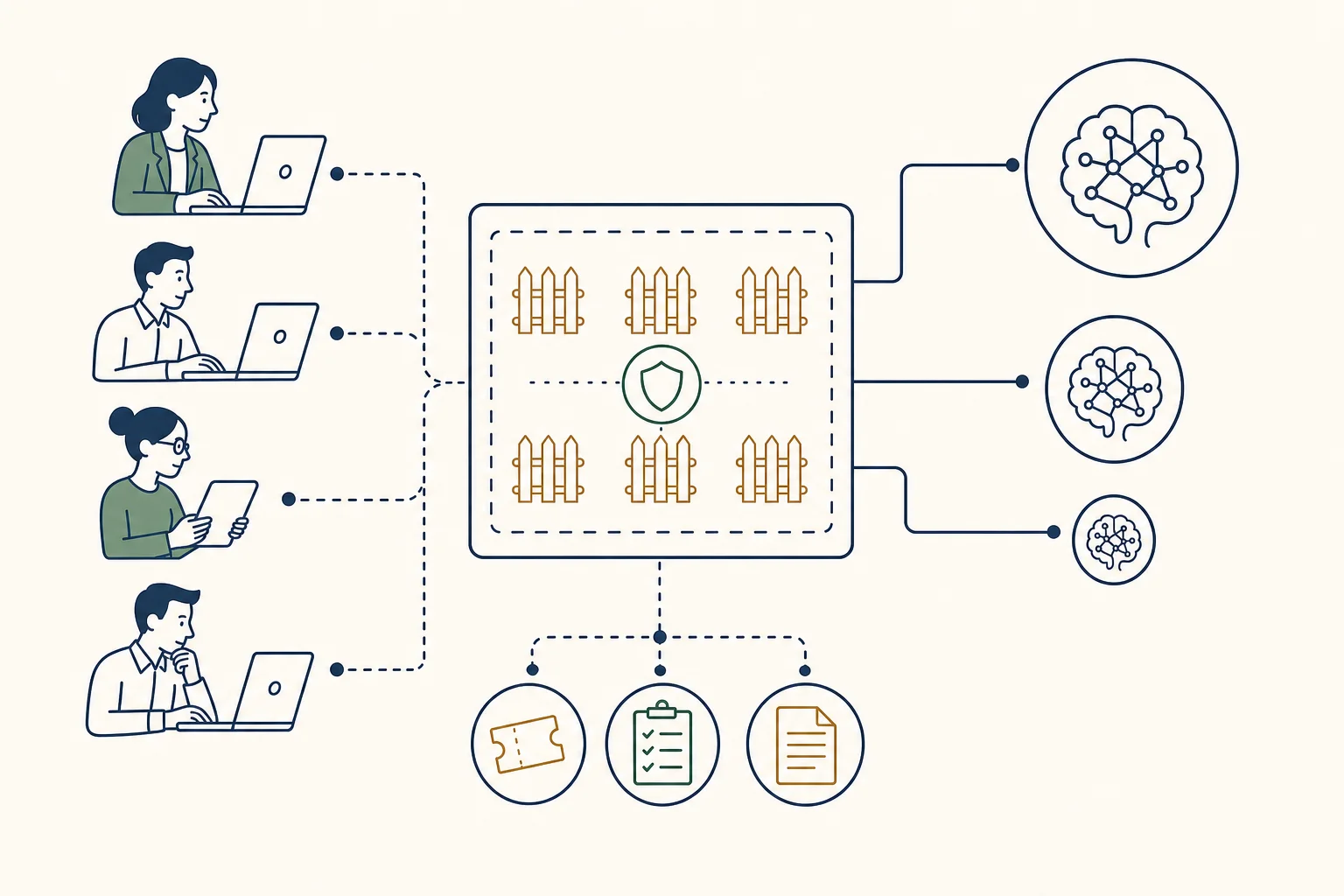

Railguards: Was selbst eingestellt werden muss

Der Unterschied zwischen einem Sprachmodell und einem brauchbaren KI-Assistenten liegt in den Leitplanken — den sogenannten Railguards. Bei den Hyperscaler-Angeboten sind diese vorgegeben. Im eigenen Proxy lassen sie sich präzise auf die Bedürfnisse des Unternehmens zuschneiden:

- Datenklassifikation. Welche Eingaben werden vom Proxy blockiert oder zumindest geloggt? Ein simples Pattern-Matching auf Personennummern, IBAN-Felder oder als „intern/vertraulich" markierte Dokumente reicht in vielen Fällen, um die häufigsten Compliance-Risiken abzufangen.

- Modellwahl pro Use-Case. Strukturierung und Klassifikation lassen sich mit kleineren, EU-gehosteten Modellen wirtschaftlicher abbilden. Komplexe Recherchen brauchen vielleicht ein leistungsstarkes Frontier-Modell. Ein Proxy kann automatisch das richtige Modell für die Aufgabe wählen.

- Berechtigungsmodell. Welcher Mitarbeiter darf welche Tools nutzen? Auf welche Wissensbasis hat er Zugriff? Wer darf nicht nur lesen, sondern auch Aktionen auslösen? Diese Granularität fehlt in den Hyperscaler-Angeboten weitgehend.

- Logging und Audit-Trail. Welche Anfrage wurde wann mit welchem Modell zu welchen Kosten gestellt? Diese Sicht braucht jeder Compliance-Verantwortliche, der KI-Nutzung im Unternehmen nicht nur „erlauben" will.

- Trainingsdaten-Schutz. Bei jeder Anfrage explizit den „no-training"-Flag setzen, und das auf API-Ebene durchsetzen — nicht nur als Häkchen in einer Oberfläche.

Custom Tools: KI, die echte Prozesse bedient

Der zweite große Hebel eines selbst betriebenen KI-Proxys: er kann mit Custom Tools ausgestattet werden — also mit Funktionen, die ein Sprachmodell aufrufen kann, um konkrete Aktionen in den Geschäftssystemen des Unternehmens auszulösen. Beispiele:

Ticketsystem

Mitarbeiter beschreibt eine Störung im Chat → Modell formuliert daraus ein strukturiertes Ticket im internen System, klassifiziert die Priorität und ordnet es dem zuständigen Team zu. Mit einer Bestätigung des Nutzers wird das Ticket gespeichert.

Hinweisgeber-Meldung

Anonymisierte Eingabe wird über den Proxy an das Hinweisgeberportal weitergeleitet — strukturiert, mit korrektem Workflow-Status, ohne dass der Mitarbeiter die fünf Schritte des Compliance-Tools beherrschen muss.

Wissensabfrage mit Quellen

Frage zu interner Dokumentation → der Proxy ruft die RAG-Pipeline auf, recherchiert in den eigenen Dokumenten, formuliert eine Antwort mit Fundstellen. Im Gegensatz zur Hyperscaler-Variante: die Dokumente verlassen das Unternehmensnetz nicht.

Audit-Eintrag erstellen

Aus einem Vor-Ort-Bericht („In Halle 4 fehlt die Sicherheitsunterweisung von ...") wird über das Modell ein strukturierter Audit-Befund mit Bewertung, Verantwortlichkeit und Frist — direkt im Auditportal angelegt.

Vorgang oder Reklamation eröffnen

Telefonnotiz oder E-Mail-Zusammenfassung wird über den Proxy zu einem strukturierten Vorgang im Prozesssystem. Statt manueller Übertragung aus dem Notizblock: ein Sprachbefehl genügt.

Der entscheidende Unterschied zu Copilot & Co

Hyperscaler-Assistenten kennen die internen Werkzeuge eines Mittelständlers nicht. Sie können Texte umformulieren und Mails entwerfen — aber kein Ticket aufmachen, keinen Vorgang anlegen, kein Hinweis melden. Ein selbst betriebener Proxy hingegen wird mit den firmenspezifischen Tools verheiratet — und macht KI damit von einer netten Schreibhilfe zu einem aktiven Mitarbeiter in den eigenen Geschäftsprozessen.

Anbieter im Fokus: KI-Proxy aus dem ProcessHub

Eine im deutschen Mittelstand verfügbare Plattform, die genau diese Architektur out-of-the-box liefert, ist ProcessHub der CamData GmbH. Der KI-Proxy ist eines der Module — gepaart mit dem zentralen Datenbestand der Plattform, den vorhandenen Prozessmodulen (Ticket, Audit, Hinweis, Reklamation) als ansprechbare Tools und einem konfigurierbaren Railguard-Set.

Worauf Sie bei der Auswahl achten sollten

Eine knappe Checkliste für die Bewertung eines KI-Proxy- bzw. KI-Assistenten-Stacks:

- Lizenzmodell. Pro Kopf oder pro Verbrauch? Bei mittelständischer Mitarbeiterzahl mit gemischter Nutzungsintensität ist Verbrauch fast immer wirtschaftlicher.

- Modellunabhängigkeit. Lassen sich verschiedene LLM-Anbieter parallel nutzen? Ein Tool, das nur OpenAI kann, ist eine neue Abhängigkeit — keine Befreiung aus der alten.

- Custom-Tools auf interne Systeme. Kann der Assistent Tickets erstellen, Vorgänge eröffnen, Auditeinträge anlegen — oder ist er auf reines Text-Erzeugen beschränkt?

- Railguard-Konfiguration. Wie tief lassen sich Berechtigungen, Datenklassen und Modellwahl steuern? Ohne Konfigurierbarkeit ist ein Proxy nur ein Lizenz-Pooling-Werkzeug.

- Audit-Trail. Welche Anfrage wurde wann mit welchem Modell und welchen Kosten gestellt? Ohne diese Sicht ist Compliance schwierig.

- Datenschutz. Wo liegt der Proxy, welche Drittanbieter sind beteiligt, gibt es AV-Verträge nach Art. 28 DSGVO?

Fazit

Die KI-Nutzung im Mittelstand wird sich in den nächsten Jahren von der Schatten-IT (einzelne Mitarbeiter mit ChatGPT-Privataccounts) zu einer durchgängigen Plattformentscheidung verschieben. Die Frage ist allerdings nicht „Copilot oder Gemini" — sondern: eigener Proxy oder fremder Lizenztarif?

Für viele mittelständische Strukturen mit gemischten Nutzungsprofilen ist der eigene Proxy die wirtschaftlich tragfähigere Lösung — und sie hat zwei strategische Vorteile, die in den Hyperscaler-Tarifen nicht enthalten sind: Steuerbarkeit (eigene Railguards) und Integration (Custom-Tools auf interne Prozesse). Wer KI nicht nur als Schreibhilfe, sondern als Bestandteil seiner Geschäftsprozesse versteht, kommt um diese Architektur kaum herum.